Réunion

Capteurs de vision et caméra intelligentes - Focus Architectures pour la Vision et l'IA

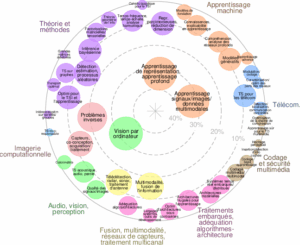

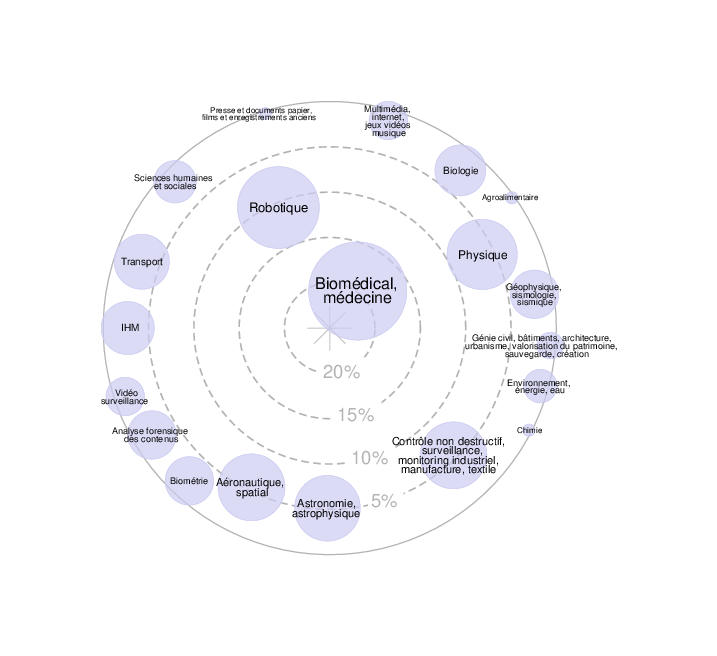

Axes scientifiques :

- Adéquation algorithme-architecture, traitements embarqués

Organisateurs :

- - François Berry (IP)

Nous vous rappelons que, afin de garantir l'accès de tous les inscrits aux salles de réunion, l'inscription aux réunions est gratuite mais obligatoire.

Inscriptions

5 personnes membres du GdR IASIS, et 0 personnes non membres du GdR, sont inscrits à cette réunion.

Capacité de la salle : 40 personnes. 35 Places restantes

Inscriptions closes pour cette journée

Annonce

L’objectif de cette journée est d’échanger à propos des dernières recherches effectuées dans le domaine des capteurs de vision et des caméras intelligentes.

Dans le domaine des capteurs d’image CMOS, de nouveaux dispositifs ont vu le jour qui intègrent directement dans le plan focal (ou près du plan focal) des algorithmes complexes de traitement et d’analyse de l’image, comme par exemple l’extraction de caractéristiques pour la reconnaissance de formes. De plus, des technologies émergentes, telles que l’intégration 3D, les memristors etc., permettent d’envisager de nouveaux opérateurs ou de nouvelles architectures.

On assiste aussi à une coopération de plus en plus étroite entre le capteur d’images et les unités de traitement embarquées au plus proche du capteur. De tels systèmes de vision, sont aujourd’hui capables d’acquérir et d’analyser le flot d’images en temps réel afin de produire du contenu sémantique de la scène observée. De plus, en considérant les possibilités d’interconnexion de tels systèmes au sein de réseaux d’objets communicants, on note l’émergence de nouvelles activités de recherche (coopération de capteurs, traitements distribués, communication intelligente, cloud-computing, …).

De ce fait, en plus de mettre en avant les travaux effectués ces dernières années par la communauté sur les capteurs de vision et caméra, une partie de cette journée sera dédiée aux architectures de calcul pour l’image et l’IA afin de mettre au contact les équipes impliquées (de l’architecture à l’application) afin de réfléchir à de futurs axes de recherches et de possibles collaborations.

De nombreuses équipes de nos communautés ont obtenus des résultats remarquables ces dernières années. Aussi, nous sollicitons des contributeurs, à la fois sur les aspects matériels (circuits, architectures, systèmes…), les aspects algorithmiques ou méthodologiques (AAA, simulation, modélisation…) pour présenter travaux et perspectives.

Pour proposer une contribution, veuillez contacter les organisateurs : francois.berry@uca.fr, gilles.sicard@cea.fr. Date limite : 30 avril 2024

Organisateurs

- François Berry francois.berry@uca.fr

- Gilles Sicard gilles.sicard@cea.fr

Programme

Programme de la journée :

9h - Acceuil

9h30-10h - "Smart and fast CMOS image sensors"

Wilfried UHRING (iCube, Univ. de Strasbourg)

10h-10h30 - "Carbon impact assessment of CMOS image sensors"

Olivier WEPPE (IETR, INSA Rennes)

10h30-11h - "Ultra low power smart imager with embedded AI"

Arnaud VERDANT (CEA Leti, Grenoble)

11h-11h30 - "Exploring Analog Computing: The Next Frontier for AI?"

Mohamed BOUCHAKOUR (UCA - Univ. Clermont-Ferrand)

11h30-12h - "Sensing Images with Event-Based Techniques"

Laurent FESQUET (TIMA, Univ. Grenoble Alpes)

Pause repas

13h30-14h - "Hemi-Spherical Update Graph Neural Network for Low-Latency Event-Based Computer Vision"

Thomas MESQUIDA (CEA List, Grenoble)

14h-14h30 - "Spiking Neuron Model for Event-Based Vision : Examples, Training and Applications"

Xavier LESAGE (TIMA, Univ. Grenoble Alpes)

14h30-15h - "Embedded event-based vision"

Tomasz KRYJAK (LIP6, Univ. Jussieu)

15h-15h30 - "Kalix: Shutterless thermal imaging with FPGAs"

Kamel ABDELOUAHAB (Sma-Rty - Clermont-Ferrand)

15h30-16h - "Unsupervised STDP-based Separated Spiking Convolutions applied to Human Action Recognition"

Mireille EL ASSAL (CRIStAL, Univ. de Lille)

16h30 - Fin de la journée

15 personnes membres du GdR ISIS, et 12 personnes non membres du GdR, sont inscrits à cette réunion.

Résumés des contributions

Cette journée s'est structurée autour de 10 présentations très variées. La journée a permis principalement de voir les avancées et les travaux menés actuellement par la communauté dans deux domaines majeurs de l'état de l'art des systèmes de vision embarqués (Smart Vision Systems) : l'IA proche capteur et les systèmes d'imagerie à base de capteur de vision à évènement (Event-Based vision Sensors). Ces présentations ont permis des échanges très intéressants avec un public mêlant académique et industriel.

Contributions orales :

- "Smart and fast CMOS image sensors", Wilfried UHRING (iCube, Univ. de Strasbourg)

- "Carbon impact assessment of CMOS image sensors", Olivier WEPPE (IETR, INSA Rennes)

- "Ultra low power smart imager with embedded AI", Arnaud VERDANT (CEA Leti, Grenoble)

- "Exploring Analog Computing: The Next Frontier for AI?", Mohamed BOUCHAKOUR (UCA - Univ. Clermont-Ferrand)

- "Sensing Images with Event-Based Techniques", Laurent FESQUET (TIMA, Univ. Grenoble Alpes)

- "Hemi-Spherical Update Graph Neural Network for Low-Latency Event-Based Computer Vision", Thomas MESQUIDA (CEA List, Grenoble)

- "Spiking Neuron Model for Event-Based Vision : Examples, Training and Applications", Xavier LESAGE (TIMA, Univ. Grenoble Alpes)

- "Embedded event-based vision", Tomasz KRYJAK (LIP6, Univ. Jussieu)

- "Kalix: Shutterless thermal imaging with FPGAs", Kamel ABDELOUAHAB (Sma-Rty - Clermont-Ferrand)

- "Unsupervised STDP-based Separated Spiking Convolutions applied to Human Action Recognition", Mireille EL ASSAL (CRIStAL, Univ. de Lille)