Réunion

Matrices et tenseurs aléatoires pour l'inférence et l'apprentissage

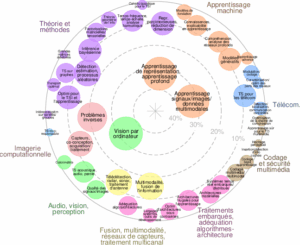

Axes scientifiques :

- Théorie et méthodes

GdRs impliqués :

Organisateurs :

Nous vous rappelons que, afin de garantir l'accès de tous les inscrits aux salles de réunion, l'inscription aux réunions est gratuite mais obligatoire.

Inscriptions

11 personnes membres du GdR IASIS, et 8 personnes non membres du GdR, sont inscrits à cette réunion.

Capacité de la salle : 150 personnes. 131 Places restantes

Annonce

Cette journée scientifique, co-organisée par le GdR IASIS et le RT Mathématiques et Physique axe MEGA, sera consacrée au rôle des matrices aléatoires et des tenseurs aléatoires en inférence statistique et en apprentissage machine. Ces objets aléatoires offrent un cadre théorique puissant et fructueux pour étudier et proposer des estimateurs et des algorithmes adaptés à des données de grande dimension, étant donc en phase avec les régimes typiques des problèmes abordés dans les domaines applicatifs susmentionnés.

Réciproquement, les problématiques issues de l’inférence et de l’apprentissage machine constituent une source riche de nouveaux modèles et de questions théoriques pour l’étude des matrices et tenseurs aléatoires. Elles stimulent le développement de techniques innovantes à l’interface des probabilités, des statistiques, de la physique et de l’optimisation, contribuant ainsi à un dialogue riche et fécond entre théorie et applications.

Orateur.ice.s invité.e.s

- Hugo Lebeau (INRIA)

- Bruno Loureiro (DIENS, CNRS)

- Vanessa Piccolo (IdePHICS, EPFL)

Appel à contributions

Nous invitons les doctorants, post-doctorants et jeunes chercheurs/chercheuses à soumettre une proposition pour présenter leurs travaux lors de l’événement. Les présentations dureront entre 20 et 25 minutes, suivies de 5 à 10 minutes de questions-réponses. Ces interventions seront l’occasion de partager des recherches récentes et de stimuler des discussions autour des défis et des avancées dans la thématique de la journée.

Les présentations sont attendues en anglais (de préférence, pour pouvoir échanger avec les orateurs invités), ainsi que les supports de présentations.

Si vous êtes intéressé(e) à participer, veuillez envoyer un e-mail à henrique.goulart@irit.fr et à raphael.butez@univ-lille.fr d’ici le 30 avril, pour soumettre un titre en un résumé relatifs à votre proposition d’intervention.

Organisateur.ice.s

- Raphaël Butez (Laboratoire Paul Painlevé)

- Guillaume Dubach (CMLS)

- Henrique Goulart (IRIT)

- Xiaoyi Mai (IMT)

Programme

10h30 - 12h00 : Mini cours par Bruno Loureiro (ENS Paris, CNRS)

12h00 - 14h00 : Pause déjeuner

14h00 - 14h45 : Exposé invité par Vanessa Piccolo (EPFL)

14h45 - 15h15 : Pause café

15h15 - 16h00 : Exposé invité par Hugo Lebeau (INRIA, ENS Lyon)

16h00 - 16h30 : Exposé contribué 1

16h30 - 17h00 : Exposé contribué 2

Résumés des contributions

Bruno Loureiro (ENS Paris, CNRS)

Invited mini-course: Some recent developments on random matrix theory for machine learning

Abstract: In this mini-tutorial, I will review some recent results on the analysis of non-linear models motivated from machine learning using tools from random matrix theory. Starting from the analysis of the two-layer neural networks at initialisation (a.k.a. random features model), we will discuss the notion of Gaussian universality, which allows to effectively treat non-linear functions of random matrix with standard tools. We will then discuss the problem of feature learning, when the network weights are trained and develop correlations with the data, and how this it can be treated with ideas that generalise universality. This will allow us to show the advantage of feature learning over kernel methods. Finally, I will discuss some of the more recent progress concerning the analysis of the spectrum of trained two-layer neural networks.

Vanessa Piccolo (EPFL)

Invited talk: TBA

Hugo Lebeau (INRIA, ENS Lyon)

Invited talk: A Random Matrix Approach to Low-Multilinear-Rank Tensor Approximation

Abstract: This work presents a comprehensive understanding of the estimation of a planted low-rank signal from a general spiked tensor model near the computational threshold. Relying on standard tools from the theory of large random matrices, we characterize the large-dimensional spectral behavior of the unfoldings of the data tensor and exhibit relevant signal-to-noise ratios governing the detectability of the principal directions of the signal. These results allow to accurately predict the reconstruction performance of truncated multilinear SVD (MLSVD) in the non-trivial regime. This is particularly important since it serves as an initialization of the higher-order orthogonal iteration (HOOI) scheme, whose convergence to the best low-multilinear-rank approximation depends entirely on its initialization. We give a sufficient condition for the convergence of HOOI and show that the number of iterations before convergence tends to 1 in the large-dimensional limit.

Contributed talk 1: TBA

Contributed talk 2: TBA