1. Contexte du stage

La vision humaine constitue un modèle remarquable de traitement de l’information, reposant sur l’intégration simultanée de multiples modalités sensorielles (vision, audition, proprioception, etc.) et la réalisation parallèle de plusieurs tâches cognitives. Contrairement aux systèmes artificiels actuels, encore souvent spécialisés et unimodaux, le système visuel humain est intrinsèquement multimodal, multitâche, robuste et adaptatif, même dans des environnements complexes et bruités.

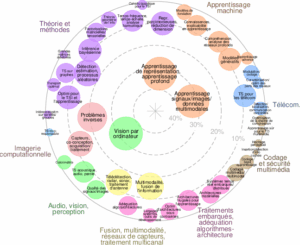

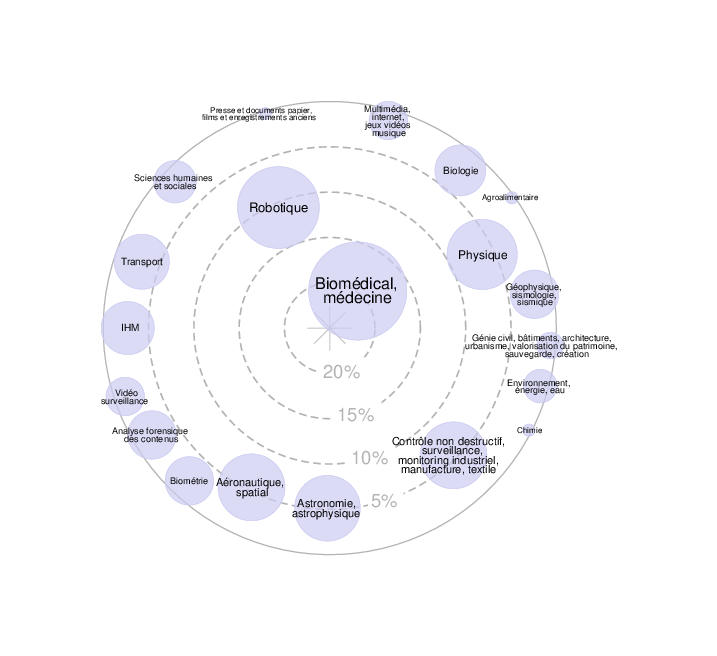

Dans ce contexte, l’intelligence artificielle, et en particulier la vision par ordinateur, s’oriente de plus en plus vers des approches inspirées de la cognition humaine, combinant fusion multimodale, mécanismes d’attention et apprentissage multitâche. Les architectures récentes basées sur les Transformers ont ouvert de nouvelles perspectives pour modéliser efficacement les relations intra- et inter-modales, ainsi que pour apprendre des représentations riches à partir de données hétérogènes. Cependant, plusieurs verrous scientifiques persistent :

- la fusion efficace de modalités hétérogènes (vidéo, audio, signaux physiologiques, etc.) ;

- la robustesse aux données manquantes ou bruitées ;

- la gestion des conflits entre tâches en apprentissage multitâche ;

- la dépendance aux données annotées.

Ce stage s’inscrit dans une démarche de recherche fondamentale visant à concevoir de nouveaux modèles de perception artificielle bio-inspirés, capables d’intégrer simultanément multimodalité et multitâche pour une vision artificielle plus robuste et généralisable.

2. Objectifs du stage

L’objectif principal du stage est de développer et évaluer un modèle de vision artificielle bio-inspiré combinant :

- fusion multimodale (vision, audio, éventuellement signaux physiologiques),

- apprentissage multitâche,

- apprentissage auto-supervisé ou faiblement supervisé,

- mécanismes d’attention inspirés de la cognition humaine.

Plus précisément, le/la stagiaire travaillera sur :

- la conception d’architectures multimodales basées sur des Transformers ;

- l’intégration de plusieurs tâches (ex. : reconnaissance d’expressions, estimation d’états affectifs, analyse comportementale, etc.) dans un cadre unifié ;

- l’étude de stratégies de fusion multimodale robustes aux modalités manquantes ;

- l’exploration de méthodes auto-supervisées pour réduire le besoin en annotations ;

- l’évaluation de la robustesse, de la généralisabilité et de l’interprétabilité des modèles.

3. Profil recherché

- Étudiant(e) en M2 / école d’ingénieur en IA, informatique, data science ou domaine connexe

- Solides bases en apprentissage automatique et en vision par ordinateur.

- Maîtrise de la programmation en Python, avec une expérience pratique des frameworks de deep learning tels que PyTorch et/ou TensorFlow.

- Intérêt pour la recherche scientifique

- Autonomie, curiosité et esprit d’initiative

4. Informations pratiques

- Type de stage : Stage de recherche (M2 / Ingénieur)

- Durée : 5 à 6 mois (flexible)

- Début : À définir (2026)

- Rémunération : ~ 680 / mois + prise en charge partielle du titre de transport

- Lieu : Laboratoire LIASD, Université Paris 8

5. Candidature

Transmettre CV, relevées de notes M1/M2 et lettre de motivation à

- YASSINE OUZAR<yassine.ouzar@univ-paris8.fr>